Yüz Değiştirme Uygulamasının Tehlikeleri

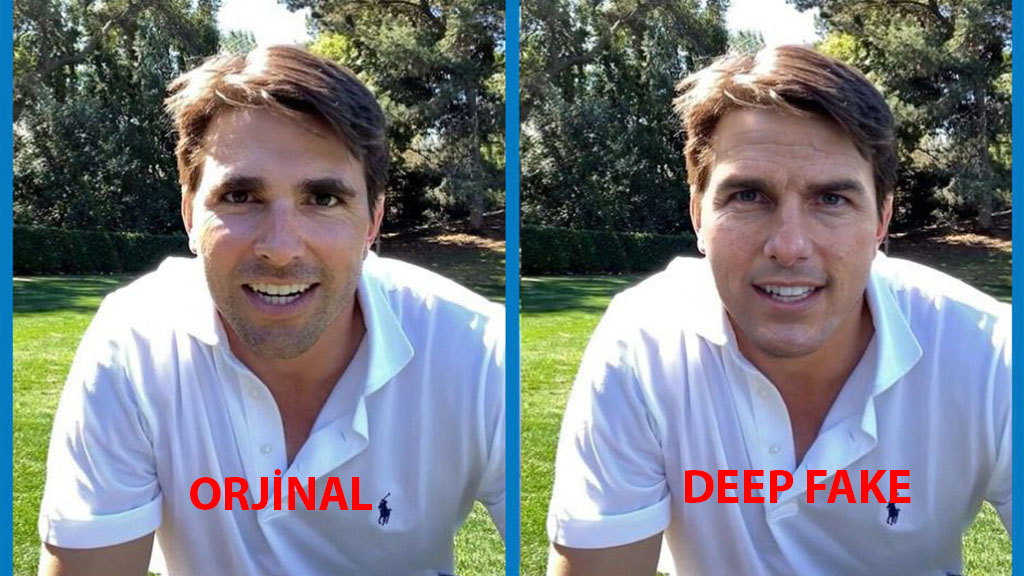

Deepfake, yapay zeka ile oluşturulan sahte videolar ve fotoğraflarla sosyal medyada tehlikeli bir trend haline geliyor.

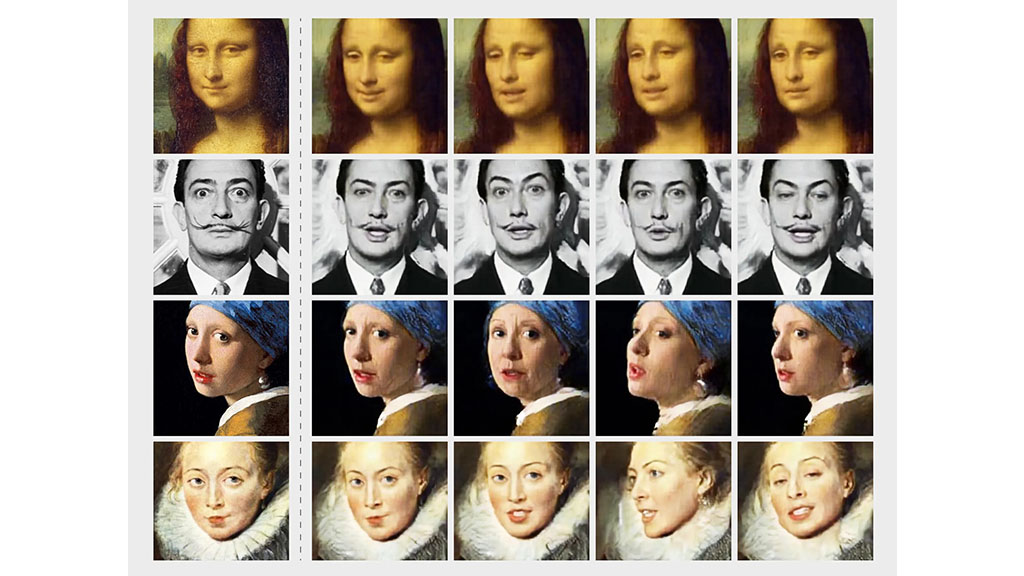

Deepfake Programı, manipülatif ve gerçek dışı içeriklerin oluşturulmasına imkan sağlayan bir yapay zeka teknolojisi olarak karşımıza çıkıyor. Bu teknoloji, yüzlerce fotoğrafın uygunsuz içeriklere eklenerek gerçekmiş gibi gösterilmesiyle büyük bir endişe kaynağı haline geliyor. Deepfake, dijital görsellerin ses, mimik ve kişinin gerçek konuşma şekli ile bütünleşerek gerçek gibi görünmesini sağlıyor.

Deepfake, Autoencoder isimli yapay sinir ağlarıyla çalışarak işlev gösteriyor. Bu teknoloji, bir kişinin yüzünü başka bir kişinin görüntüsü yerine hedef bir videoda yapıştırabiliyor. Bu şekilde, videodaki kişinin söyledikleri veya yaptıkları başka biri tarafından yapılmış gibi gösterilebiliyor.

Ancak Deepfake’in tehlikeleri de göz ardı edilemez. Deepfake videoları, gerçek ve sahte videoların ayırt edilebilmesini zorlaştırıyor. Özellikle ünlüler üzerinde denenen bu tarz videoların kişisel fotoğraflar üzerinde de kullanılma potansiyeli bulunuyor. Bu durum, herkesin Deepfake videolarının gerçek olduğuna sorgulamadan inanmasını sağlayarak toplumun güvenliğini tehdit ediyor.

Deepfake, siber zorbalık, şantaj ve hakaret gibi kötü niyetli amaçlar için kullanılabiliyor. Bu nedenle, bu teknolojinin kullanımının sınırlanması ve tespit edilmesi önem taşıyor. Deepfake, zamanla sadece ünlülerle sınırlı kalmayacak, herhangi bir kişiyi tehdit etmek veya aşağılamak için kullanılabilecek bir araç haline gelebilir.

Deepfake teknolojisi, sosyal medya platformlarında hızla yayılan manipülatif içeriklerin ve güvenlik tehditlerinin önlenmesi için gerekli önlemlerin alınmasını zorunlu kılıyor. Yapay zeka teknolojisinin ilerlemesiyle birlikte, Deepfake’in yarattığı risklerle mücadele etmek için güçlü algoritmalar ve güvenlik önlemleri geliştirilmelidir.